Cloud-DevOps - Lösungen. Wissen. Seminare.

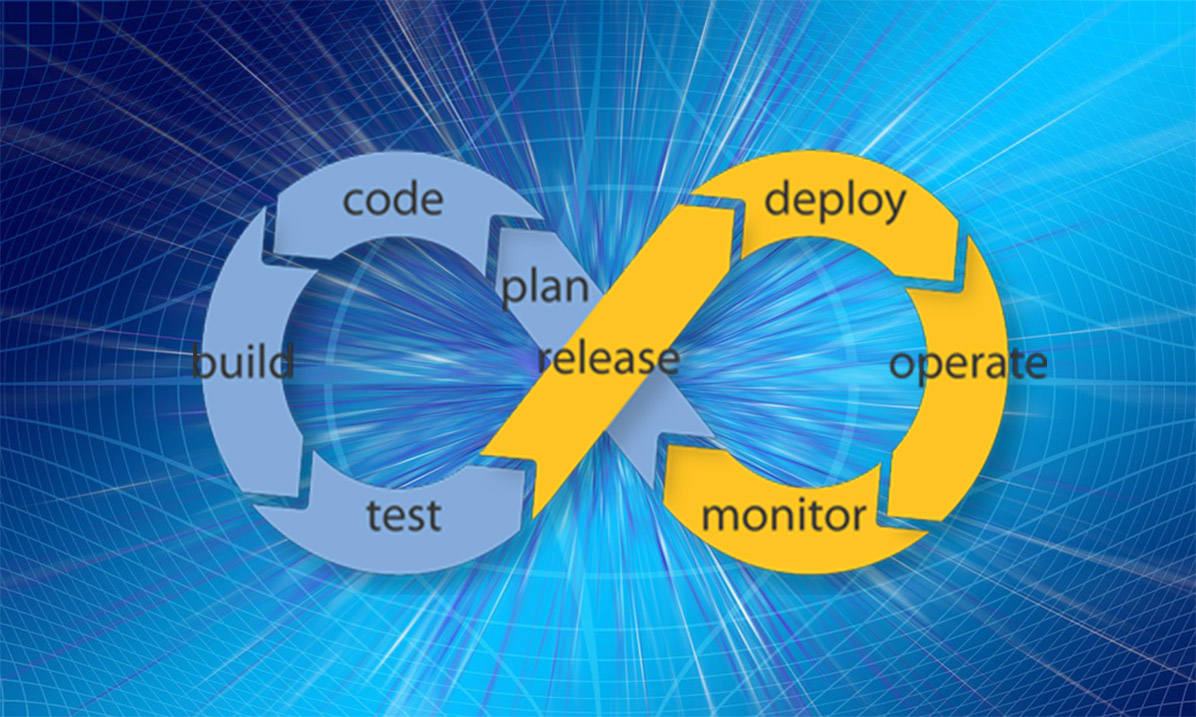

Cloud-DevOps vereint die Vorteile der Cloud-Computing-Technologie mit den agilen Prinzipien von DevOps. Es ermöglicht Ihnen, Anwendungen schnell zu entwickeln, zu testen und bereitzustellen, indem es automatisierte Prozesse und skalierbare Ressourcen in der Cloud nutzt.

Durch die Automatisierung von Entwicklung, Test und Bereitstellung können Sie Entwicklungszyklen verkürzen und schneller auf Kundenanforderungen reagieren. Sie können neue Funktionen und Updates kontinuierlich implementieren und den Time-to-Market erheblich reduzieren.

Darüber hinaus ermöglicht es Ihnen Cloud-DevOps durch die Nutzung der Ressourcen der Cloud, Ihre Infrastruktur und Kapazität problemlos an die Anforderungen Ihres Unternehmens anpassen. Sie können schnell auf Veränderungen in der Nachfrage reagieren und die Leistung Ihrer Anwendungen optimieren.

Als IT-Dienstleister unterstützen wir Sie bei der Implementierung von Cloud-DevOps. Unsere Expert:innen analysieren Ihre Anforderungen und entwickeln eine maßgeschneiderte Strategie für die Umsetzung von Cloud-DevOps in Ihrem Unternehmen. Wir nutzen bewährte Tools und Methoden, um die Automatisierung und Planbarkeit Ihrer Entwicklungsprozesse zu gewährleisten.